So kann Microsoft Copilot oder eine lokale KI als Chatbot in Firefox aktiviert werden

-

Sören Hentzschel -

28. März 2025 um 21:31 -

3.248 Mal gelesen -

8 Antworten

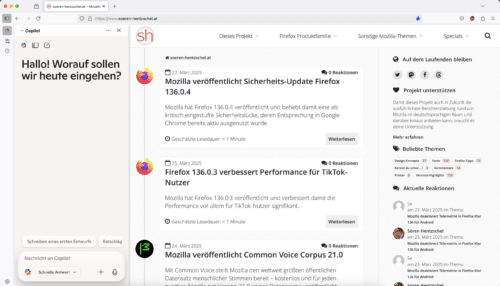

Firefox bietet eine Integration gleich mehrerer KI-Chatbots. Der Microsoft Copilot ist nicht dabei – zumindest nicht offiziell. Über eine versteckte Option lässt sich auch dieser in Firefox aktivieren, ebenso wie eine lokale KI.

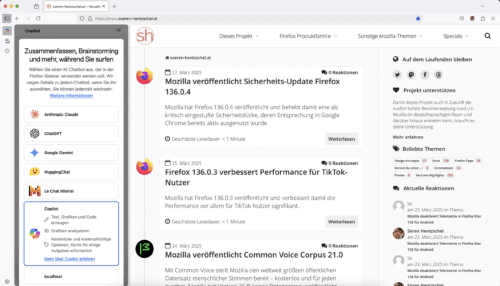

Seit Firefox 135 integriert Mozillas Browser mehrere KI-Chatbots. Dabei stehen Google Gemini, ChatGPT, HuggingChat, Anthropic Claude sowie Le Chat Mistral zur Verfügung. Die Chatbots können direkt über die Sidebar genutzt werden.

Welche Chatbots der Nutzer sieht, wird dabei über eine versteckte Option gesteuert, welche auf die Bezeichnung browser.ml.chat.providers hört. Gibt man dies in das Filterfeld von about:config ein, findet man die Option allerdings nicht. Dennoch ist die Option vorhanden und besitzt den Standardwert claude,chatgpt,gemini,huggingchat,lechat.

Wer die genannte Option in about:config mit dem Typ „String“ anlegt, kann durch Weglassen eines Anbieters die Auswahl der zur Verfügung stehenden Chatbots reduzieren. Wird die Liste hingegen durch copilot erweitert, steht nach einem Neuladen der Sidebar auch Microsoft Copilot zur Verfügung.

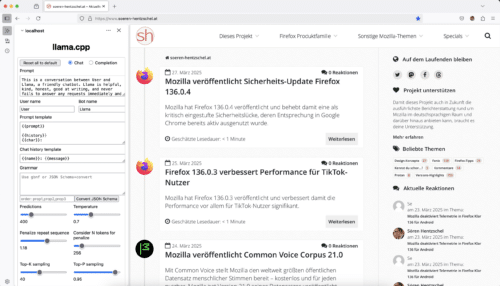

Auch localhost ist ein gültiger „Anbieter“. Darüber kann dann eine lokale KI eingebunden werden, zum Beispiel über llamafile von Mozilla.

Der Beitrag So kann Microsoft Copilot oder eine lokale KI als Chatbot in Firefox aktiviert werden erschien zuerst auf soeren-hentzschel.at.

Antworten 8